De Pixels à Personalização: Como o HunyuanCustom da Tencent Está Redefinindo a Geração de Vídeos por IA

A Revolução Silenciosa na Criação de Vídeo por IA

Em 8 de maio de 2025, a Tencent lançou uma atualização importante no mundo da inteligência artificial generativa – e a maioria das pessoas nem percebeu. Mas se você trabalha com marketing, mídia, e-commerce ou investimento em IA, HunyuanCustom é um nome que você vai querer lembrar. O lançamento não é apenas mais um modelo no cenário abarrotado de ferramentas de geração de vídeo – é uma mudança no nível da infraestrutura. O modelo oferece algo que nenhuma plataforma aberta ou fechada entregou de forma convincente em escala: customização de vídeo multimodal e com identidade consistente.

Em um mundo cada vez mais dominado por mídia sintética, manter a autenticidade de uma persona digital entre quadros, ações e entradas não é apenas um desafio técnico – é uma necessidade de negócio. Quer você esteja utilizando um embaixador de marca digital, animando a aparência de uma celebridade ou substituindo personagens em conteúdo de vídeo sem precisar refilmar, a consistência da identidade é a variável decisiva.

O HunyuanCustom foca diretamente nisso com uma série de inovações arquiteturais. O resultado? Um salto em controle, customização e coerência visual – três pilares do conteúdo sintético escalável.

Por Que Isso Importa Agora?

Vídeo já representa mais de 80% do tráfego da internet. A IA generativa está sendo usada para acelerar tudo, desde a produção de anúncios e criação de avatares até instrutores virtuais e demonstrações animadas de produtos. Mas até agora, um problema limitava uma adoção mais ampla: a inconsistência. Rostos mudam entre quadros. O áudio não acompanha o movimento labial. A identidade se perde em movimento.

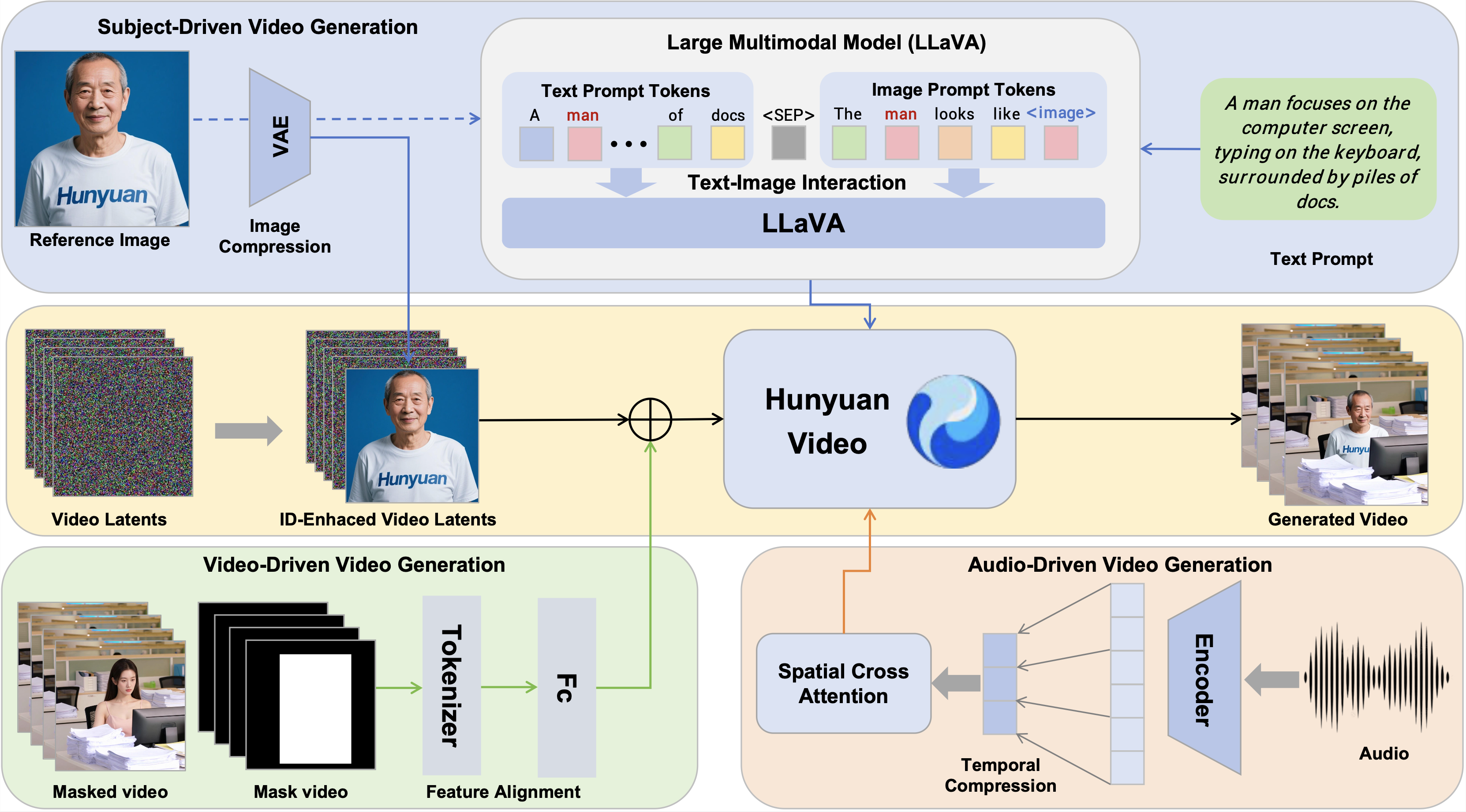

O HunyuanCustom da Tencent aborda essas falhas diretamente, integrando entradas de controle multimodais (texto, imagens, áudio, vídeo) e costurando-as em uma saída consistente e controlada. É mais do que apenas uma melhoria de recurso – é um aprimoramento de infraestrutura sobre o qual se pode construir.

Para investidores, a mensagem é clara: o HunyuanCustom está posicionado para ser um modelo fundamental para conteúdo de vídeo por IA de nível comercial. E seu compromisso com o código aberto pode inclinar a balança na dinâmica futura da participação de mercado.

Por Dentro da Arquitetura: O Que Torna o HunyuanCustom Diferente?

Vamos detalhar as principais inovações e por que elas são importantes para desenvolvedores e usuários corporativos:

1. Condicionamento Multimodal Que Funciona

Ao contrário de muitos antecessores que falham sob combinações complexas de entrada, o HunyuanCustom funde texto, imagens, áudio e vídeo em uma saída coerente. Se você quer um gêmeo digital falante de um CEO ou uma modelo de roupa reagindo a um som ambiente, este modelo pode lidar com isso.

📌 Inovação chave: A Fusão Texto-Imagem baseada em LLaVA cria uma compreensão unificada da identidade visual e da instrução verbal – crucial para movimento e expressão naturais.

2. Motor de Consistência de Identidade

No coração do sistema está o Módulo de Aprimoramento de ID de Imagem. Usando latentes VAE e embeddings posicionais 3D, ele propaga a identidade de um sujeito pelos quadros de vídeo sem simplesmente "copiar e colar" características faciais. Isso garante que o sujeito permaneça reconhecível sob movimento, oclusão ou mudanças de expressão.

📌 Por que importa: Modelos anteriores sofriam com tremores e perda de identidade ao longo do tempo. As atualizações de consistência temporal do HunyuanCustom corrigem isso.

3. Áudio Sem Perder a Essência

Em modelos tradicionais, injetar áudio para sincronizar lábios frequentemente degrada a identidade visual do sujeito. A solução da Tencent: o AudioNet com Identidade Desacoplada, que aplica atenção cruzada espacial por quadro, garantindo sincronização precisa sem distorção visual.

📌 Relevância para negócios: Permite criar avatares virtuais com som natural para suporte ao cliente, e-learning ou marketing interativo.

4. Edição Rápida e Eficiente Baseada em Vídeo

O HunyuanCustom também permite que vídeos existentes sejam usados como fontes de entrada – por exemplo, substituindo um personagem de fundo ou inserindo um novo porta-voz em um anúncio previamente filmado.

📌 Avanço técnico: Seu Módulo de Injeção Orientada por Vídeo adiciona recursos codificados de vídeos de referência diretamente no fluxo de geração com mínima sobrecarga computacional.

Avaliando o Hype: É Realmente Melhor?

Em comparações técnicas contra plataformas de código aberto e comerciais como Vidu, Pika, Keling e Skyreels, o HunyuanCustom lidera em várias frentes.

| Modelo | Face-Sim (↑) | DINO-Sim (↑) | Consistência Temporal (↑) |

|---|---|---|---|

| Vidu 2.0 | 0.424 | 0.537 | 0.961 |

| Keling 1.6 | 0.505 | 0.580 | 0.914 |

| Pika | 0.363 | 0.485 | 0.928 |

| HunyuanCustom | 0.627 | 0.593 | 0.958 |

Esses números indicam um modelo que supera na preservação da identidade, realismo da cena e coerência temporal. Isso não é apenas uma vitória técnica – é um facilitador de negócios.

Aplicações no Mundo Real Com Potencial Comercial

A força do HunyuanCustom reside em sua adaptabilidade em diversos casos de uso:

Publicidade e Marketing

Marcas podem usar embaixadores digitais consistentes em campanhas localizadas, com mensagens sincronizadas labialmente em vários idiomas.

Experiência Virtual e E-Commerce

Marcas de roupa podem gerar demonstrações de movimento realistas a partir de imagens estáticas, reduzindo a dependência de sessões de fotos caras.

Educação e Treinamento

Instrutores de vídeo personalizados podem ser criados para diferentes segmentos demográficos, mantendo qualidade visual e tonal consistente.

Edição e Produção de Vídeo

Estúdios agora podem adaptar filmagens antigas com novos personagens ou mensagens sem refilmagens ou artefatos de deepfake.

Jogos e Metaverso

Avatares realistas podem ser animados com mínima entrada, liberando personalização de próxima geração para mundos virtuais.

Desafios e Considerações Para Adoção

Embora o desempenho seja promissor, alguns pontos de atenção merecem ser destacados:

- Requisitos de Hardware: O modelo recomenda 80 GB de memória de GPU para saída ótima – o que significa que não é plug-and-play para a maioria dos criadores.

- Vantagem da Tencent: A escala e a qualidade do sistema vêm da base de recursos da Tencent. Reproduzir resultados similares pode não ser fácil sem infraestrutura semelhante.

- Validação de Terceiros: Embora o modelo seja de código aberto, muitas de suas comparações de benchmark são realizadas internamente. A adoção generalizada dependerá da replicação e validação pela comunidade.

Infraestrutura Para a Próxima Economia de Conteúdo

O HunyuanCustom não é apenas mais um modelo de IA – é um avanço no nível de plataforma para como as empresas podem gerar, customizar e escalar conteúdo de vídeo de alta qualidade. A mudança para o lançamento aberto o torna ainda mais disruptivo, especialmente em um mercado competitivo repleto de soluções de "jardim murado".

Para criadores de conteúdo, agências e investidores, o HunyuanCustom representa um ponto de virada. Com controle de identidade superior, flexibilidade multimodal e desempenho de nível empresarial, ele oferece a espinha dorsal para a próxima fase da mídia sintética.